Bild: Christoph Schramm/Deepmind on Unsplash

Dieser Artikel erschien im MIZ Aktuell Blog der ZHdK.

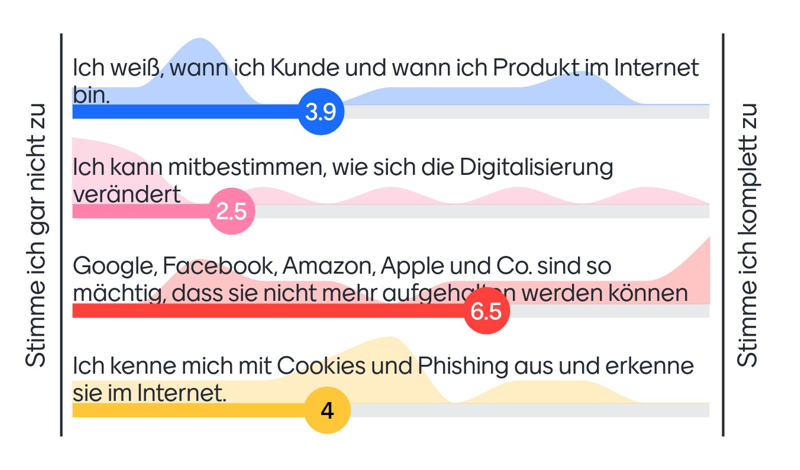

Eines wird schnell klar: Ohne Algorithmen geht in der digitalen Welt gar nichts. Jeder Computer ist eine Algorithmen ausführende Maschine und jede Software basiert auf ihnen. Das Gefühl, machtlos ausgeliefert zu sein, ist stark. Dies zeigt auch das Stimmungsbild zu Beginn des zweiten Kurstages.

Können wir überhaupt Einfluss auf die Aktivität und den Einsatz von Algorithmen nehmen? Dieser brennenden Frage ging Destination Digital im zweiteiligen Workshop «Algorithmen. Was tun sie und wie gehen wir damit um» mit Expert:innen von Dezentrum auf den Grund.

Was sind algorithmische Entscheidungssysteme?

Die Grundregel jedes Algorithmus lautet «wenn – dann». Daten werden nach einer Regel zu einem Ergebnis verarbeitet. Das können ganz einfache Handlungen sein oder aber auch eine ganze Kette von Entscheidungen.

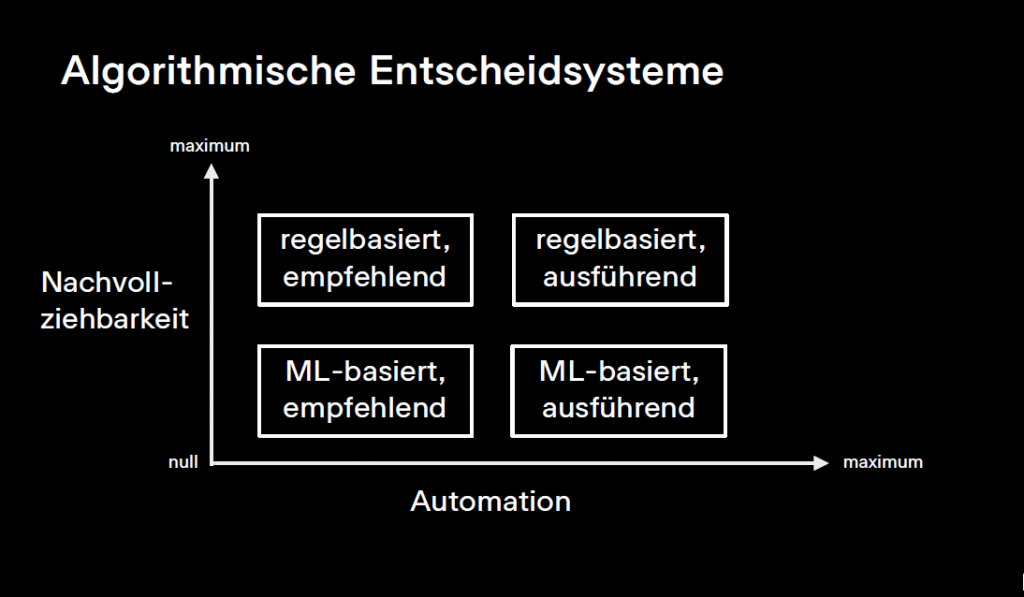

Automatisierte (dh. durch Software ausgeführte) Berechnungsverfahren, welche basierend auf Datenanalysen Schlussfolgerungen ziehen und darauf basierend Handlungsempfehlungen abgeben oder diese ggf. selbst ausüben.

Anna Boos, Dezentrum

So wird etwa dank Algorithmen ein Vertipper stillschweigend korrigiert oder ich kann über Empfehlungen wunderbare neue Musik entdecken. Oftmals merke ich gar nicht, dass welche im Spiel sind und teilweise bin ich so sehr an ihre Unterstützung gewohnt, dass ich etwa eine Suche in einer Datenbank ohne Korrektursystem richtig mühsam finde.

Die Bandbreite reicht also von willkommenen «Helfern» bis zu recht unheimlichen «Verfolgern». Besonders delikat sind Anwendungen, die einen Einfluss auf mein Leben oder meine Privatsphäre haben: etwa in der Diagnostik, bei Recruiting Tools, in personalisierten Empfehlungen, Wearables und Gesundheitstrackern, aber auch bei Predictive Policy oder beim Autonomen Fahren.

Wie können wir zwischen «gut» und «böse» unterscheiden? Und sind wir überhaupt bereit, für besseren Datenschutz auf gewisse Gewohnheiten und Annehmlichkeiten zu verzichten?

Was „weiss“ ein Algorithmus und wie lernt er?

Jede:r von uns produziert in der realen wie auch in der virtuellen Welt ständig Daten. Diese teilen wir bewusst und unbewusst. Und selbst aus Daten, die wir mit unserem Einverständnis teilen (collected data) werden weitere Daten generiert, die auf Grund dieser Werte abgeleitet werden (interferred data). Es ist also nahezu unmöglich, wirklich anonym in der digitalen Welt zu agieren.

Abgesehen davon, dass es beim Datenschutz (noch) keine globalen Regelungen gibt, ist es auch kaum möglich, ein solches Datenschutzgesetz im Netz durchzusetzen. Wegen fehlender Transparenz weiss ich oft nicht, wann ich Objekt einer algorithmischen Entscheidung bin. Ebenso wenig weiss ich, auf welchen Kriterien diese Entscheidung basiert.

Um das Agieren von Algorithmen zu verstehen, ist es also wesentlich zu wissen, woher und aus welchen Kontexten diese Daten stammen. Entscheidend für die Nachvollziehbarkeit der Funktionsweise ist auch, ob die Daten regelbasiert von Menschen definiert wurden oder die Maschine selbst «lernt»? Denn Machine Learning (ML) ist derart komplex, dass es von Menschen oft nicht mehr nachvollziehbar ist.

Ethik von Algorithmen

Unweigerlich kommen wir so zum Begriff der «Künstlichen Intelligenz» und beginnen zu hinterfragen: Ist die blosse Repetition dessen, was wir als intelligent betrachten und die Tatsache, dass diese Handlung durch eine Maschine durchgeführt wird, noch intelligent? Denn Algorithmen sind per se dumm, sie führen nur aus, was man ihnen antrainiert hat. Und somit schliesst sich der Kreis: Das Wesentliche sind die Daten. Aber nur in strukturierter Form werden sie wertvoll.

Und wieder geht es um die Nachvollziehbarkeit, die ganz besonders wichtig ist, wenn ein direkter Einfluss auf mein Leben oder auf meine Autonomie besteht. Der Algorithmus reproduziert nämlich nur das, was er erhält oder selbst errechnet. Die Resultate entsprechen dem Training und deshalb wäre es elementar, nicht nur die Herkunft der Daten zu kennen, sondern auch, wie nach welchen Modellen oder aus welchem soziografischen Kontext sie gewonnen wurden. Selbst die Diversität der Personen, die den Algorithmus programmieren, kann einen Einfluss haben.

Chancen

- Automatisierung und Effizienzsteigerung

- Zusammenhänge offenlegen

- Prävention (z.B. durch predictive analytics)

- Personalisierte Angebote

Risiken

- Eingriffe in die Privatsphäre

- Fehlende Nachvollziehbarkeit

- Fairness-Probleme

- Korrelation nicht gleich Kausalität

- Ungenügende Sensibilierung

Digitale Selbstverteidigung

Die Frage, wann ich im Internet als Kunde und wann ich zum Produkt werde, zieht sich auch eine Woche später wie ein roter Faden durch den zweiten Workshop, in dem wir uns in «Digitaler Selbstverteidigung» üben.

If something is free, you are the product.

Pauschalisiert stellen wir fest, dass bei allen Gratisdiensten zwar nicht in Geldwerten, aber immer mit Daten «bezahlt» wird. Auch wenn der Inhalt meiner Mails von der KI nicht verstanden wird, geben die Wörter viel über mich preis. Und so trainieren wir ständig Bots: Bei der Abbruchrate auf Netflix, bei Fehlern in Sprachlernprogrammen, selbst wenn ich bei einem Chaptcha Ampeln oder Radfahrer kennzeichnen muss, wird nicht nur geprüft, dass ich kein Roboter bin, sondern ich trage auch zum Lernprogramm von selbstfahrenden Autos bei.

David Bürgisser macht uns mit Geschäftsmodellen bekannt und deckt auf, wie geschickt sich grosse Konzerne durch Subunternehmen vernetzen und so durch einfacheren Datenaustausch zu regelrechten Datenkraken werden.

Sich diesen Mechanismen ganz zu entziehen, keine Spuren zu hinterlassen, ist eigentlich unmöglich. Aber immerhin kann man versuchen, durch bewusste Einschränkungen und durch gute Information die Datenspur zu reduzieren. Wir lernen Apps kennen, die ihre Policy offen legen und auch solche, die helfen, Gefahren zu erkennen und zu vermeiden. Und wir können sogar akustisch mitverfolgen, wann Cookies auf unserem Gerät aktiv sind!

Was lernen wir von Algorithmen?

Angeregt von Beispielen, bei denen Algorithmen in künstlerischen Prozessen eine Rolle spielen (etwa in Grafik- oder Musiknotationsprogrammen) oder ganz bewusst künstlerisch und kreativ eingesetzt werden, versuchen wir unter Abwägung von Chancen und Risiken Szenarien für unsere eigenes Arbeitsumfeld an der ZHdK zu entwickeln, bei denen algorithmische Entscheidungen eine Rolle spielen könnten. Und da wir uns nun besser auskennen, beginnen die Gedanken doch wieder kreativ zu wuchern. Und dies teilweise ganz bewusst auch gegen die Denkweise von Algorithmen: «wenn – dann nicht»!

Ein Workshop in zwei Teilen von Destination Digital. Referent:innen waren Anna Boos, Ramona Sprenger und David Bürgisser von Dezentrum.

Weiterlesen: Ratgeber Digitale Selbstverteidigung auf digitale-gesellschaft.ch.

Dieser Artikel erschien zuerst im MIZaktuell Blog.